Welchen PC braucht man für KI-Training? Ein umfassender Leitfaden

Künstliche Intelligenz (KI) hat sich in den letzten Jahren zu einem der spannendsten Technologiebereiche entwickelt. Ob neuronale Netzwerke, maschinelles Lernen oder Deep Learning – das Training solcher Modelle ist äußerst rechenintensiv. Für professionelle Anwendungen ist oft spezialisierte Hardware nötig. Doch welche Komponenten braucht ein PC, um KI-Modelle effizient zu trainieren? In diesem Artikel erfährst du alles Wichtige zur idealen PC-Konfiguration für KI-Training – von der CPU über die GPU bis hin zum RAM und Speicher.

Inhaltsverzeichnis

- Einleitung: Warum ist Hardware beim KI-Training so wichtig?

- CPU – Das Rückgrat des Systems

- GPU – Das Herzstück für Deep Learning

- Arbeitsspeicher (RAM)

- Datenspeicher – SSDs vs. HDDs

- Mainboard, Netzteil und Kühlung

- Betriebssystem und Software-Kompatibilität

- Beispielkonfigurationen für verschiedene Budgets

- Cloud vs. lokaler PC – Wann lohnt sich was?

- Fazit: Die richtige Balance finden

1. Warum ist Hardware beim KI-Training so wichtig?

KI-Training, insbesondere Deep Learning, erfordert das Verarbeiten großer Datenmengen und komplexer mathematischer Operationen. Während kleinere Modelle auf herkömmlicher Consumer-Hardware laufen können, benötigen moderne Anwendungen mit großen neuronalen Netzwerken spezialisierte Hardwarekomponenten. Entscheidend sind vor allem Rechenleistung (CPU), Grafikleistung (GPU), Speicherbandbreite (RAM) und Datendurchsatz.

Quelle: Puget Systems – Machine Learning Benchmarks

2. CPU – Das Rückgrat des Systems

Obwohl die GPU beim KI-Training meist im Mittelpunkt steht, spielt auch die CPU eine wichtige Rolle. Sie steuert das System, bereitet Daten für die GPU auf und führt viele Vorverarbeitungsschritte durch.

Empfehlung:

- Mittelklasse: AMD Ryzen 7 7700X oder Intel Core i7-13700K

- High-End: AMD Threadripper PRO oder Intel Xeon für parallele Datenverarbeitung

Achte auf eine hohe Anzahl an Kernen (8–16+) und eine starke Single-Core-Leistung für schnelleres Datenmanagement.

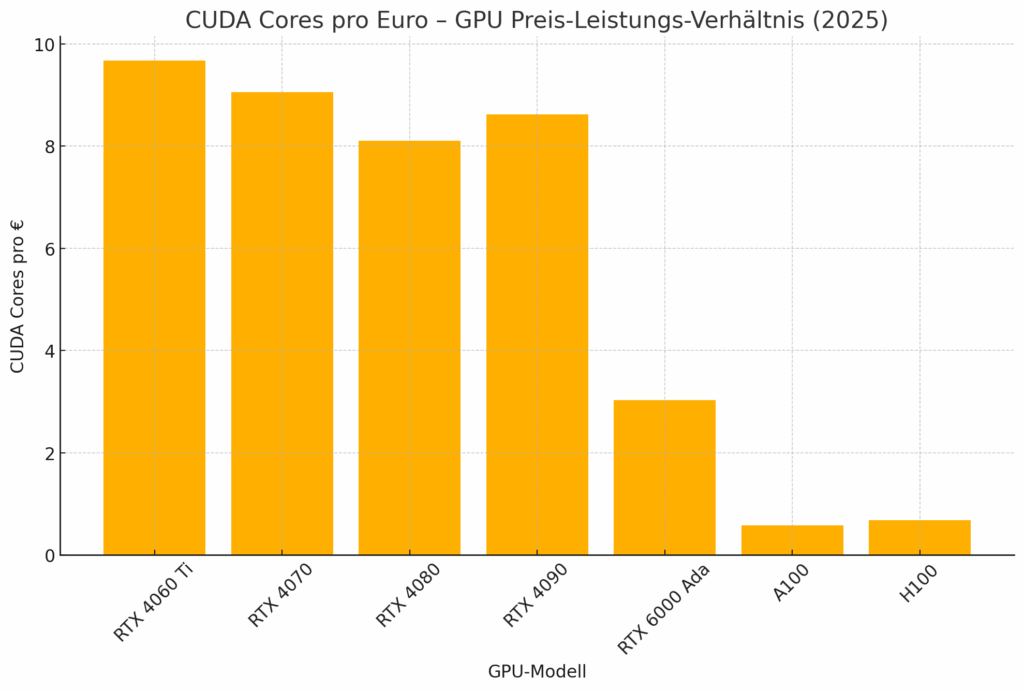

3. GPU – Das Herzstück für Deep Learning

Die GPU (Graphics Processing Unit) ist der wichtigste Baustein beim KI-Training. Frameworks wie TensorFlow oder PyTorch nutzen CUDA (Compute Unified Device Architecture) von NVIDIA, um Berechnungen massiv zu parallelisieren.

Quelle: NVIDIA CUDA Toolkit

Wichtige GPU-Kriterien:

- VRAM: Mindestens 12 GB, besser 24–48 GB bei großen Modellen

- Tensor Cores: Erlauben Mixed-Precision-Berechnungen für schnelleren Trainingsdurchlauf

- CUDA-Kompatibilität: Notwendig für PyTorch, TensorFlow, JAX und Co.

Quelle: TensorFlow GPU Support

Empfohlene GPUs (2024):

- Einsteiger: NVIDIA RTX 4060 Ti (8–16 GB)

- Mittelklasse: NVIDIA RTX 4070 Ti / 4080

- High-End: NVIDIA RTX 4090 oder A6000

- Professionell: NVIDIA H100, A100, oder L40S für Serveranwendungen

Tipp: Achte auf Kühlung und Gehäusegröße – High-End-Karten benötigen viel Platz und Luftstrom.

4. Arbeitsspeicher (RAM)

Der RAM puffert Daten zwischen CPU, Speicher und GPU. Für KI-Anwendungen gilt: Je mehr, desto besser.

Empfehlung:

- Minimum: 32 GB DDR5

- Optimal: 64–128 GB für größere Datensätze

- Für Forschung oder sehr große Modelle: 256 GB+

Schneller RAM (DDR5 mit hoher Taktfrequenz) verbessert den Datendurchsatz und verhindert Flaschenhälse beim Training.

5. Datenspeicher – SSDs vs. HDDs

Beim KI-Training müssen oft mehrere Gigabyte bis Terabyte an Daten geladen, transformiert und gespeichert werden.

Empfehlung:

- NVMe SSDs (Gen4 oder Gen5): Für schnelles Laden und Speichern von Datensätzen

- Kapazität: Mindestens 1 TB SSD + optional 2–4 TB HDD als Archiv

- Mehrere Laufwerke: Trennung von Betriebssystem, Trainingsdaten und Modellen steigert Performance

6. Mainboard, Netzteil und Kühlung

Mainboard:

- Unterstützung für PCIe 4.0 oder 5.0 (für aktuelle GPUs und SSDs)

- Ausreichend RAM-Steckplätze und M.2-Slots

- Stabile Spannungsversorgung für High-End-CPUs

Netzteil:

- Leistung: Mindestens 750W für Mittelklasse-GPUs, 1000W+ für RTX 4090

- Zertifizierung: 80+ Gold oder besser

Kühlung:

- CPU-Kühler: Hochwertige Luft- oder Wasserkühlung

- Gehäuse: Gute Airflow-Architektur, mehrere Lüfter, ggf. Staubfilter

7. Betriebssystem und Software-Kompatibilität

Die meisten KI-Frameworks sind auf Linux (z. B. Ubuntu) optimiert, aber auch Windows wird zunehmend unterstützt. Voraussetzung ist ein kompatibler NVIDIA-Treiber und CUDA-Toolkit.

Wichtige Tools:

- Python

- CUDA / cuDNN

- PyTorch / TensorFlow

- Jupyter Notebooks / VSCode

- Docker (für reproduzierbare Umgebungen)

8. Beispielkonfigurationen für KI-PCs

Einsteiger (unter 2000 €):

- CPU: AMD Ryzen 7 7700

- GPU: NVIDIA RTX 4070 (12 GB)

- RAM: 32 GB DDR5

- SSD: 1 TB NVMe

- Netzteil: 750W 80+ Gold

- Betriebssystem: Ubuntu oder Windows 11

Fortgeschrittene (ca. 3000–4000 €):

- CPU: Intel i9-14900K

- GPU: NVIDIA RTX 4090 (24 GB)

- RAM: 64 GB DDR5

- SSD: 2 TB Gen4 NVMe + 4 TB HDD

- Netzteil: 1000W

- Kühlung: AIO Wasserkühlung

Professionelle Workstation (6000 €+):

- CPU: AMD Threadripper PRO 7975WX

- GPU: NVIDIA RTX 6000 Ada oder A100

- RAM: 128–256 GB ECC

- Speicher: 4 TB NVMe SSD + RAID-Array

- Mainboard: EEB mit IPMI

- Netzteil: 1200–1600W redundant (für Servereinsatz)

9. Cloud vs. Lokaler PC – Was lohnt sich?

Nicht immer ist der Eigenbau sinnvoll. Cloud-Services wie AWS, Google Cloud oder Paperspace bieten GPU-Instanzen auf Stundenbasis. Für gelegentliches Training oder Prototyping kann das günstiger sein. Bei regelmäßigem Training großer Modelle rechnet sich der eigene KI-PC oft nach wenigen Monaten.

| Vorteil Lokaler PC | Vorteil Cloud |

|---|---|

| Keine Mietkosten | Skalierbar, on-demand |

| Volle Kontrolle | Kein Aufbau nötig |

| Datensicherheit | Zugriff auf High-End-GPUs (z. B. H100) |

| Einmalige Investition | Keine Wartungskosten |

10. Fazit: Die richtige Balance finden

Ein PC für KI-Training braucht vor allem eine starke GPU, viel RAM und schnellen Speicher. Für Entwickler, Forscher oder Startups, die regelmäßig mit großen Datensätzen und neuronalen Netzen arbeiten, lohnt sich die Investition in eine maßgeschneiderte Workstation. Wer dagegen nur gelegentlich Modelle trainiert, kann mit Cloud-Services starten oder einen Mittelklasse-PC mit RTX 4070–4080 wählen.

Weiterführende Quellen

-

PC reinigen: So säuberst du deinen Computer richtig

PC säubern: So reinigst du deinen Computer richtig – Innen & Außen Warum ist es…

-

Warum du keine Tools wie CCleaner verwenden solltest

Zeitalter der „One-Click-Lösungen“ Im Zeitalter der „One-Click-Lösungen“, die alle vermeintlichen PC-Probleme lösen sollen, sind Tools…

-

Gaming-PC übertakten: Der ultimative Guide für mehr FPS und Leistung

Was ist Overclocking? Overclocking bezeichnet das gezielte Erhöhen der Taktfrequenz von Hardware-Komponenten wie CPU, GPU…

-

Home Office PC 2025: Die besten Modelle & Tipps

Der perfekte Home Office PC: Worauf es wirklich ankommt In Zeiten flexibler Arbeitsmodelle gewinnt das…